Ausgangslage die uns beschäftigt

Was tun wenn der aktuelle Server 50+ TB Daten fasst und eine kostengünstige Sicherungslösung benötigt wird?

Und warum sollte man sich Gedanken machen über zu starre/klassische Sicherungen?

Derzeit befassen wir uns bei in4matics mit der Frage, wie in kleineren Unternehmen die Kosten für eigenständige Datensicherungen reduziert werden können. Dieses Thema ist generell immer wieder Gegenstand von Diskussionen, da IT-Sicherheit mit Ihren Kosten die Gewinne schmälert, aber nichts direkt zum Umsatz beiträgt. Nicht zuletzt, da sich wachsende Bedürfnisse nur sehr schwer planen lassen und kleinste Entscheidungen zu überraschenden Engpässen führen können. Geräte welche im grösseren Rahmen ausbaufähig sind, sind natürlich erhältlich, operieren aber in einer hier nicht weiter erläuterten Preisklasse.

Eine Punktlandung aus Kosten-Nutzenperspektive ist weiter kaum möglich, weil voller Festplatten kein Potenzial mehr bieten und ungenutzter Speicherplatz zugleich keinen Mehrwert darstellt. Weiter reizen Sicherungsvorgänge die Server nicht ansatzweise aus. Unter dem Strich bedeutet dies, dass bei einem Beispiel mit 2 identischen Konfigurationen, nach 4 Jahren ein System komplett abgeschrieben ist und weniger als ca. 5% einen prophylaktischen Mehrwehrt geleistet hat.

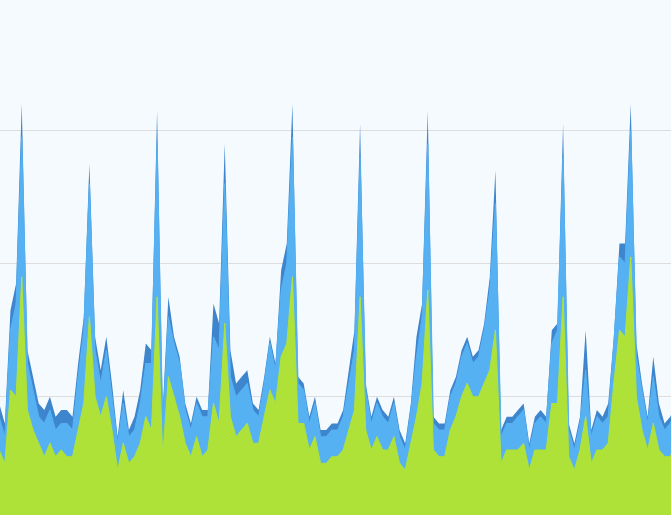

Im letzten Punkt der Ausganglage möchte ich auf die Ausführung, rsp. die Häufigkeit von Sicherungen eingehen.

Sicherungen basieren oft darauf, dass diese zu festen Zeitpunkten oder Intervallen eine 1 zu 1 Kopie machen. Das hat den Nachteil, dass der komplette Datenbestand immer und immer wieder abgeglichen wird, auch wenn sich zu Bürorandzeiten keine Veränderungen ergeben haben. Dieser Vorgang belastet ebenso das wichtige Quellsystem. Wer folglich öfters grössere Sicherungen macht, wird spürbare Systemlastschwankungen feststellen.

Bei wachsenden Datenbeständen kommt oft die Kompromissfrage: wie oft sollen Sicherungen gemacht werden? denn..

A) sollten Daten nicht verloren gehen, folglich möglichst schnell und daher sehr häufig gesichert werden,

B) sollte der Server nebst Sicherungen noch etwas anderes machen und die eigentliche Arbeit nicht einschränken

C) Sollten sich Backups nicht gegenseitig einholen wenn die Datenstände immer schneller wachsen.

D) Sind Quellserver und Backupserver Laufwerke(Volumen/Festplatten) nicht gleich gross, muss die Sicherung in mehrere Gruppen aufteilt werden und sich so auf alle Sicherungslaufwerke verteilen. Weil sich Verzeichnisstrukturen unterschiedlich schnell in der Grösse verändern können, ist eine starre Aufteilung von Hand keine nachhaltige Lösung.

E) Sollten sich Datensicherungen nicht selbst zerstören, wie z.B durch Ransomware Angriffe. Ein Bedrohung die Daten auf Server verschlüsselt und Lösegeld erpresst. In diesen Fällen hilft nur eine gute Datensicherung. Bei klassischen Backups ist man gegen solche Angriffe relativ bescheiden geschützt, da der Backupserver jegliche (in diesem Fall unbrauchbar verschlüsselte Daten) erkennt und beim nächsten Sicherungslauf das sehr wichtige Backup schlicht überschreibt.

Unser Lösungsansatz den wir entwickeln

Die Datengrösse hat sich im Durchschnitt in den letzten Jahren drastisch vergrössert. Zudem hat die Digitalisierung dazu beigetragen, dass immer mehr Daten in immer grösserer und ausgiebiger Qualität vorliegt. Viele Unternehmungen haben daher schon aus der letzten Periode Geräte, die heute für die operativen Umständen nicht mehr ganz reichen und daher gegen neue ausgetauscht wurden, aber dennoch funktionsfähig sind. Da Server nach 4-6 Jahren immer noch funktionieren, können auch diese einen weiteren Zweck verfolgen.

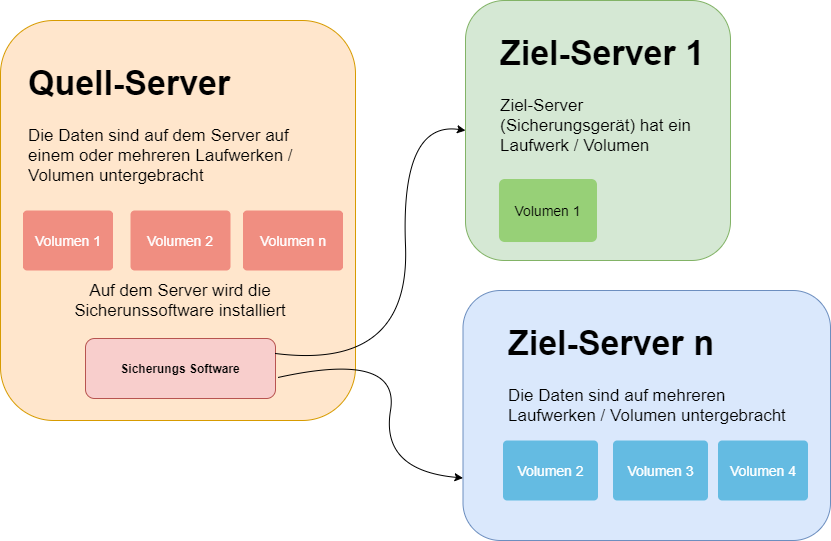

Der Ansatz liegt darin, eine grosse Datenmenge von mehreren Quell-Server Laufwerken auf beliebig viele Sicherungsgeräte automatisier zu verteilen, so dass im Desaster Fall ohne besondere Vorkenntnisse alle Daten wiederhergestellt werden können. Die Datenverteilung passiert automatisch. Um zusätzlich Energiekosten zu sparen, können Backupserver regelmässig abgeschaltet werden.

Um die Performance zu schonen, werden die Daten live überwachen und nur Änderungen am Zustand übertragen. Mit diesem Vorgehen, lassen sich auch Unregelmässigkeiten erkennen und die Verarbeitung vorzeitig zum Schutz der Daten unterdrücken.

Technische Anforderungen

- Quellsystem Zustand aktiv überwachen und das mit möglichst wenig Ressourcen. Die Daten liegen auf 1-n Volumen, folgen jedoch einer einheitlichen Struktur

- n Speicherziel-Systeme (Backupserver) werden via SFTP angebunden und folgen ebenfalls der gleichen Struktur

- Aus Wartungsgründen ist eine einzige Applikation für die Lösung angestrebt welche auf dem Quellserver liegt

- Datenbank für die Zustandsbewertung, Aufgabenverteilung, Nachvollziehbarkeit der Datenstände

- UI zur Kontrolle (Übersicht, Zustandswerte, Start & Stop von Verarbeitung)

- Alarming Funktion ( Für dringende Meldungen ) via Telegram Messenger

- Quellesystem verarbeitet ermittelte Änderungen nur bei genügen Systemressourcen

- Wartbarkeit gewährleisten (Komplexe Code und Prozess-Optimierungen vermeiden)

Funktionsweise

Entwicklungstand der Software

- Alle notwendigen Komponenten sind eingebunden (abgeschlossen)

- Logik und Ausnahmehandling ( in Arbeit )

- Alarming (nicht abgeschlossen )

- Testing ( nicht abgeschlossen )